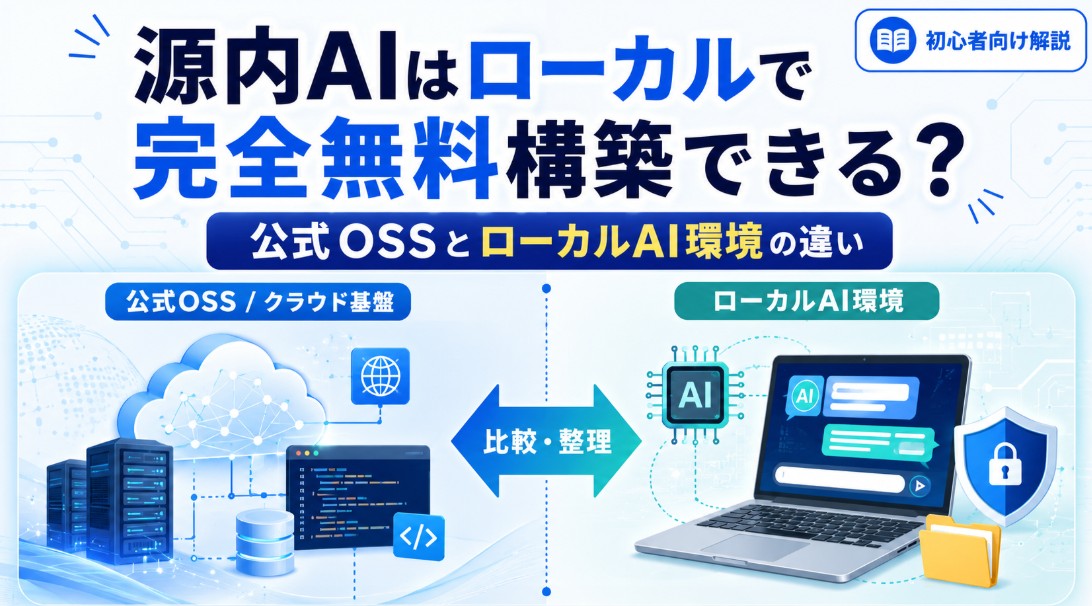

デジタル庁がガバメントAI「源内」をオープンソースとして公開したことで、自治体、企業、個人開発者の間でも「自分の環境で源内AIのような仕組みを構築できるのではないか」という関心が高まっています。特に気になるのは、次のような点です。

源内AIはローカルPCだけで動かせるのか?

完全無料で使えるのか?

OpenAI APIやClaude APIなしで構築できるのか?

公式の源内と同じものを再現できるのか?結論から言うと、公式の源内AIをそのままローカルPCだけで完全無料で再現するのは現実的ではありません。

ただし、OllamaやOpen WebUIを使えば、ChatGPTのように使える「源内風のローカルAI環境」は無料で構築できます。

この記事では、公式の源内AIと、ローカルで作れるAI環境の違いを整理しながら、完全無料で構築するための考え方を解説します。

源内AIとは何か

源内AIとは、デジタル庁が開発・運用している生成AI利用基盤です。

デジタル庁の公式GitHubでは、源内について「行政職員が業務特化の生成AIアプリケーションを、迅速かつ安全かつ簡単に利用できる環境」と説明されています。源内Webは、AWS社のオープンソース「Generative AI Use Cases」をベースに、チーム管理機能、AIアプリ管理機能、外部マイクロサービスとして構築したAIアプリの追加・実行機能などを加えた構成です。

つまり、源内AIは単なるチャットボットではありません。

生成AIを使うための画面

業務ごとのAIアプリ

チーム管理

AIアプリ管理

外部AIアプリとの連携

RAGなどの業務データ参照

運用・監視に必要な機能これらをまとめた「行政向けの生成AI利用基盤」と考えるとわかりやすいです。

なぜ源内AIがOSSとして公開されたのか

デジタル庁は、地方公共団体や政府機関が安全にAIを活用し、行政事務やサービスの効率化、質の向上を実現できる環境を整備する目的で、源内と同様の生成AI利用環境を構築可能なソースコード等をOSSとして公開したと説明しています。

また、OSSとして公開することで、各自治体や政府機関が似たようなAI基盤をそれぞれ重複して開発することを防ぎ、特定の事業者やサービスへの依存を抑える狙いもあります。

要するに、源内AIのOSS公開は「誰でもそのまま無料AIサービスを使えるようにする」というよりも、「行政AI基盤を構築する際の参照実装として使えるようにする」という意味合いが強いです。

公式に公開されているもの

デジタル庁の公式noteでは、源内は大きく分けて2種類のシステムで構成されていると説明されています。

源内Web

行政実務用AIアプリ公開されているものは、源内のWebインターフェース部分のソースコードと構築手順、そして源内で利用している一部AIアプリの開発テンプレート・実装です。

源内AIアプリ側では、Azure、Google Cloud、AWS向けの構成が公開されています。たとえば、Azure向けにはLLMをセルフデプロイして利用する開発テンプレート、Google Cloud向けには法律条文データを参照するAIアプリ、AWS向けには行政実務用RAGの開発テンプレートが示されています。

公開されていないもの

ここが非常に重要です。

源内AIがOSS公開されたからといって、デジタル庁で実際に使われている環境が丸ごと公開されたわけではありません。

デジタル庁の公式noteでは、公開しないものとして次の内容が示されています。

実際の源内で参照している内部マニュアル類

デジタル庁が権利を保有しない大規模言語モデルや書籍等

中央省庁で稼働中の源内の生ログ等つまり、公式の源内AIと同じ業務データ、内部マニュアル、実運用ログ、大規模言語モデルがそのまま手に入るわけではありません。

源内AIはローカルPCだけで完全無料構築できるのか

結論として、公式源内AIをそのままローカルPCだけで完全無料構築するのは難しいです。理由は、公式の源内はWebインターフェースやAIアプリのテンプレートが公開されている一方で、AIアプリ側にはAWS、Azure、Google Cloudといったクラウド構成が含まれているためです。

また、公式の源内Webはチーム管理、AIアプリ管理、外部マイクロサービス連携、運用監視などを含む基盤です。単純なローカルチャットAIとは設計思想が異なります。

したがって、ローカルPCだけで完全無料にこだわる場合は、次のように考えるのが現実的です。

公式源内そのものを完全再現する

↓

これは難しい

源内の考え方を参考にして、ローカルAI環境を作る

↓

これは可能完全無料で作るなら「源内風ローカルAI」が現実的

ローカルで無料構築するなら、次の構成が現実的です。

Windows

↓

Ollama

↓

ローカルLLM

↓

Open WebUI

↓

ブラウザで使えるAIチャット環境OllamaはローカルPC上で大規模言語モデルを動かすためのツールです。Open WebUIは、Ollamaなどと連携できるWeb画面を提供するセルフホスト型のAIプラットフォームです。

Open WebUIの公式ドキュメントでは、Open WebUIはmacOS、Linux、Windowsで動作し、Dockerによる導入が推奨されています。

また、OllamaのWindows版はWindows 10 22H2以降を要件としており、NVIDIA GPUを使う場合は対応ドライバーが必要です。

この構成であれば、OpenAI APIやClaude APIを使わずに、ローカルPC上でAIチャット環境を構築できます。

「完全無料」の意味に注意

ここでいう完全無料とは、次の意味です。

OpenAI API料金が不要

Claude API料金が不要

ChatGPT Plus料金が不要

AWS、Azure、Google Cloudの利用料が不要

ローカルPC内でAIモデルを動かせるただし、以下は無料ではありません。

PC本体の費用

電気代

ストレージ容量

GPUやメモリなどのハードウェア負荷

保守管理にかかる作業時間特にローカルLLMは、モデルサイズが大きくなるほどPCへの負荷が高くなります。高性能なモデルを快適に動かしたい場合は、メモリやGPU性能が重要になります。

ローカルAIでできること

OllamaとOpen WebUIを使ったローカルAI環境では、次のようなことができます。

ChatGPT風のチャット画面を使う

ローカルLLMに質問する

API料金なしで文章生成する

ローカルPC内で会話履歴を管理する

外部サービスに文章を送らずにAIを使う

用途別プロンプトを登録する

文書を読み込ませて質問する特に、社内文書、行政文書、議案書、報告書、マニュアルなどを扱う場合、外部AIサービスにデータを送信しないローカルAI環境は大きなメリットがあります。

ただし、ローカル環境であっても、機密情報の管理、アクセス制御、バックアップ、端末のセキュリティ対策は必要です。

公式源内とローカルAIの違い

公式源内とローカルAI環境の違いを整理すると、次のようになります。

公式源内

行政向けの生成AI利用基盤

クラウド構成を含む

チーム管理やAIアプリ管理がある

行政実務用AIアプリとの連携を想定

運用・監視機能を含む

源内風ローカルAI

個人や小規模利用向け

ローカルPCで動かせる

Open WebUIとOllamaで構築可能

無料で始めやすい

公式源内そのものではないつまり、公式源内は「組織向けのAI基盤」、ローカルAIは「個人・小規模向けのAI実行環境」と考えるとわかりやすいです。

どちらを選ぶべきか

個人や小規模事業者が試すなら、まずはOllamaとOpen WebUIで十分です。

AIをローカルで試したい

無料で使いたい

API料金をかけたくない

社内文書を外部に出したくない

ChatGPT風の画面で使いたいこのような目的であれば、源内の公式ソースをいきなり触るよりも、OllamaとOpen WebUIから始めた方が早いです。

一方で、自治体や企業が本格的なAI基盤を作りたい場合は、公式の源内OSSを参考にする価値があります。

複数部署でAIを使いたい

AIアプリを管理したい

チームごとに利用範囲を分けたい

RAGを業務システムに組み込みたい

クラウド環境で運用したい

調達仕様の参考にしたいこの場合は、公式の源内WebやAIアプリテンプレートを調査する意味があります。

まとめ

源内AIは、デジタル庁が開発・運用する行政向けの生成AI利用基盤です。OSSとして一部が公開されましたが、公式の源内そのものをローカルPCだけで完全無料再現できるわけではありません。

ただし、OllamaとOpen WebUIを使えば、源内AIのように「業務で使えるAI環境」をローカルで無料構築することは可能です。

重要なのは、次の切り分けです。

公式源内そのものを完全再現したい

↓

クラウド構成や公式ソースの理解が必要

無料でローカルAIを使いたい

↓

Ollama + Open WebUIが現実的

源内の思想を参考に業務AIを作りたい

↓

ローカルAI環境を土台にカスタムするまずは、ローカルでAIを動かす環境を作ることから始めるのがおすすめです。そこから、用途別プロンプト、文書検索、RAG、業務テンプレートを追加していけば、源内風の実用的なAI環境に近づけることができます。